搜索查詢

EL-AIcar自(zì)動駕駛算法平台

系統功能概述

EL-AIcar自(zì)動駕駛算法競賽平台是真正的智能車或是輪式機(jī)器人,它在傳統智能車的基礎上通過搭載功能強大(dà)的導航計(jì)算機(jī),由導航計(jì)算機(jī)連接深度攝像機(jī)來(lái)實現人的雙眼功能,由導航計(jì)算機(jī)連接的激光(guāng)雷達對場景掃描并通過軟件(jiàn)建模來(lái)判定障礙物位置從(cóng)而實現自(zì)主導航。

導航計(jì)算機(jī)是以ubuntu爲操作系統,并在其上的運行機(jī)器人的ROS系統,該ROS系統可(kě)挂接機(jī)器人建模軟件(jiàn)來(lái)仿真設計(jì)各類機(jī)器人,也可(kě)挂接仿真軟件(jiàn)來(lái)驗證相(xiàng)關識别算法或控制算法從(cóng)而較爲直觀地看(kàn)到機(jī)器人模拟的運行狀态,爲真實機(jī)器人的設計(jì)與控制提供完備的理論基礎。同時ROS系統還(hái)可(kě)以與OPENCV、TensorFlow等視頻圖像識别軟件(jiàn)進行數據交互,将其AI的視覺功能發揮到極緻。

車體控制單元部分(fēn)采用基于ARM Cortex-M4 内核的STM32F407處理器,主要完成電源管理、電機(jī)控制及測速、紅(hóng)外或超聲波避障、IMU姿态解算及GPS定位功能。車體控制單元通過相(xiàng)應接口與做AI控制的導航計(jì)算機(jī)相(xiàng)連,實現導航所用數據上傳及接收導航計(jì)算機(jī)控制指令。同時引出407所有的GPIO引腳到排針,方便用戶DIY。

系統結構及硬件(jiàn)資源

|

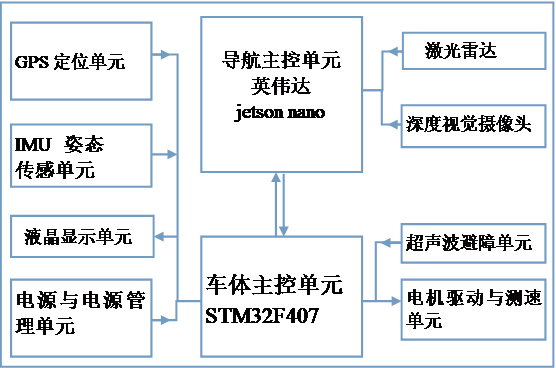

無人駕駛競賽平台可(kě)分(fēn)爲室内競賽平台與室外競賽平台,室内平台采用英偉達Jetson nano帶GPU的4核A57處理器,可(kě)自(zì)行加裝語音控制單元進行控制。采用真實的四輪電動代步車平台,搭載高性能計(jì)算機(jī)、高速激光(guāng)雷達與GPS單元。其硬件(jiàn)系統結構框圖如(rú)下所示。

整車采用Coretx-M4内核的STM32F407ZE作爲主控制器,同時,在小車上有豐富的外圍擴展資源(如(rú):電機(jī)控制、無線通信、液晶顯示以及各種傳感器模塊等),它可(kě)以搭配多種傳感器,自(zì)身(shēn)即可(kě)完成無人駕駛智能傳感小車的基本功能(包括小車前進、後退、轉彎、避障等)、也可(kě)以自(zì)動駕駛(包括循迹自(zì)動駕駛、感應卡路(lù)徑自(zì)動駕駛、GPS導航自(zì)動駕駛等)、同時可(kě)實現無線通信(ZIGBEE、藍牙等無線通信控制小車方向)。 |

自(zì)動駕駛算法平台小車系統框圖 |

軟件(jiàn)配置

1、ubuntu操作系統。

2、機(jī)器人ROS系統。

3、無線遙控手柄,可(kě)實現不低于1km無線遙控。

4、移動端app可(kě)實現手機(jī)遙控和姿态遙控。

主要硬件(jiàn)參數說(shuō)明

車身(shēn)結構

車身(shēn)采用全鋁合金支架,帶有擺式與獨立懸挂,外型尺寸(長X寬445*358MM),采用直徑125mm實心輪。

采用直流有刷電機(jī)(功率達35W),減速比1:27,最大(dà)速度1.3m/S,額定負載能力10Kg。帶有500線AB相(xiàng)光(guāng)電編碼器。

帶有阿克曼結構轉向功能,采用數字舵機(jī)、金屬齒輪。舵機(jī)最大(dà)角度180°,工(gōng)作電壓4.8-7.4V,扭力20Kg.cm。

采用共軸擺式懸挂,可(kě)适應不平地面。

車身(shēn)四周有四組超聲波測距模塊,采用HY-SRF05 超聲波測距模塊,2cm-450cm 的非接觸式距離(lí)感測功能, 測距精度可(kě)達高到3mm

帶有GPS定位系統:56通道,GPS L1(1575.42Mhz) C/A碼,定位精度: 2.5mCEP(SBAS:2.0mCEP),通信協議(yì): NMEA(默認)/UBX Binary ,SBAS:WAAS/EGNOS/MSAS,更新速率: 最大(dà)5Hz(默認1HZ)。

激光(guāng)雷達:思岚A1

測距範圍:0.15-12m,基于白(bái)色高光(guāng)反色物體測得(de);

掃描角度:0-360;

測距分(fēn)辨率:當測量物體在1.5米範圍内分(fēn)辨率爲小于0.5mm;否則分(fēn)辨率小于實際距離(lí)的1%;

測量頻率:2KHz-8KHz;

掃描頻率1-10Hz;

供電:5V

視覺相(xiàng)機(jī):Astra pro

深度範圍:0.6-8m;

功耗:≤2.5W,峰值電流小于500ma;

彩色圖分(fēn)辨率:1280x720@30FPS;640x480@30FPS;320x240@30FPS;

深度圖分(fēn)辨率:1280x1024@7FPS;640x480@30FPS;320x240@30FPS;160x120@30FPS;

精度:距離(lí)物體1m時,±1-3mm;

彩色FOV:H66.1’ V40.2’;

深度FOV:H58.4’ V45.5’;

數據傳輸:30-45ms;

供電:USB 5V

英偉達jetson nano B01:

CPU:ARM Coretex-A57 64-bit ,主頻1.43Ghz;4核,

GPU:128-core Maxwell @921Mhz;

内存:4 GB 64-bit LPDDR4 25.6 GB/s;

存儲:可(kě)擴展microSD卡,要求最小16GB UHS-1(超高速接口,帶寬能達到至少104Mb/s)

視頻編碼:H.264/H.265(4Kp30)

視頻解碼:H.264/H.265(4Kp60,2**4Kp30)

攝像輸入接口:MIPI CSI

攝像輸出接口:2個HDMI 2.0,Edp1.4

網絡接口:Gigabit Ethernet/M.2 Key E

USB:4個 USB 3.0, USB 2.0 Micro-B

GPIO引腳:40

額定功率:5w/10w

供電:5V

電池采用22.2V 5000ma帶保護電池,續航能力約5小時(電池容量可(kě)選)

車體主控STM32F407ZE:

CPU:支持最大(dà)主頻爲168 MHz的ARM Cortex-M4内核

内存:1024KByte FLASH,192+4KByte SRAM

LQFP-144封裝。

4個傳感器接口,可(kě)擴展20多種傳感器。

1個4.3寸TFT液晶,分(fēn)辨率480*272。

1組無線通信總線,可(kě)擴展Zigbee、CC1310、藍牙通信。

外設資源包括6個USART、12個16位的定時器、2個32位定時器、2個DMA控制器(16通道)、3個SPI、2個全雙工(gōng)I2S、3個I2C、2個CAN、3個12位ADC、2個12位DAC、SDIO、1個FSMC接口、2個USB(支持HOST/SLAVE)、1個攝像頭接口、1個硬件(jiàn)随機(jī)數生(shēng)成器以及1個10/100M以太網控制器等

可(kě)開設的實驗項目

| 基于AI CPU系統深度學習算法實驗 | |||

| 實驗01 構造線性回歸模型 | 實驗02 邏輯回歸框架 | 實驗03 叠代完成邏輯回歸模塊 | 實驗04 神經網絡模型架構 |

| 實驗05 訓練神經網絡 | 實驗06 卷積神經網絡模型架構 | 實驗07 RNN網絡模型 | 實驗08 循環神經網絡LSTM |

| 實驗09 雙向循環神經網絡 | 實驗10 動态循環神經網絡 | 實驗11 對抗生(shēng)成網絡 | 實驗12 目标識别 |

| 實驗13 自(zì)編碼器 | |||

| 基于AI CPU系統應用實驗 | |||

| 實驗01 GoogleNet物體識别 | 實驗02 FaceNet120人臉檢測 | 實驗03 神經網絡Lenet模型 | 實驗04 手語識别 |

| 實驗05 色塊跟蹤 | 實驗06 視覺建圖 | 實驗07 激光(guāng)雷達建圖 | |

| 基本功能實驗 | |||

| 實驗一 小車前進實驗 | 實驗二 小車後退實驗 | 實驗三 小車左轉實驗 | 實驗四 小車右轉實驗 |

| 實驗五 自(zì)動避障實驗 | |||

| 自(zì)動駕駛實驗 | |||

| 實驗一 循迹自(zì)動駕駛實驗 | 實驗二 GPS導航自(zì)動駕駛實驗 | ||

| 無線通信實驗 | |||

| 實驗一 無線通信控制方向實驗 | |||

| 傳感器實驗 | |||

| 實驗一 繼電器實驗 | 實驗二 光(guāng)照(zhào)度實驗 | 實驗三 溫濕度實驗 | 實驗四 紅(hóng)外測溫實驗 |

| 實驗五 氣壓計(jì)實驗 | 實驗六 攝像頭實驗 | 實驗七 GPS實驗 | |

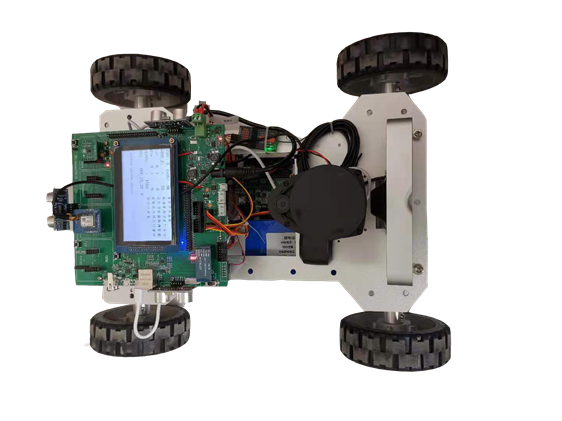

産品參考圖片

-

-

-

聯系或咨詢我們

咨詢熱(rè)線:

手機(jī):

深圳市龍崗區龍城(chéng)街道黃(huáng)閣社區京基禦景時代大(dà)廈南(nán)區904A

掃碼關注

Copyright © 2021 深圳市前海長方教育科技有限公司 版權所有 | SEO标簽